인공지능(AI)과 빅데이터 시대, 기업과 연구기관은 방대한 데이터 속에서 가치 있는 인사이트를 발굴하기 위해 노력하고 있습니다. 하지만 이 데이터에는 사용자의 민감한 개인정보가 포함된 경우가 많아, 데이터 활용과 개인정보보호 사이의 균형을 맞추는 것이 핵심 과제로 떠올랐습니다. 구글은 이 딜레마를 해결하기 위한 혁신적인 기술, ‘차등 개인정보보호 파티션 선택(DPPS, Differentially Private Partition Selection)’을 새롭게 공개하며 기술적 진일보를 이뤄냈습니다.

기존 차등 개인정보보호(DP)의 한계: ‘소음’과 ‘효용성’의 딜레마

차등 개인정보보호(Differential Privacy, DP)는 개별 사용자의 데이터가 전체 분석 결과에 미치는 영향을 통계적으로 제한하여 개인을 식별할 수 없도록 만드는 개인정보보호 기술의 ‘골드 스탠다드’로 여겨집니다. 원본 데이터에 의도적으로 ‘소음(noise)’을 추가하여 개인의 기여도를 모호하게 만드는 방식입니다. 구글 역시 대규모 언어 모델(LLM) 훈련부터 안드로이드 및 크롬의 익명 통계 수집에 이르기까지 다양한 서비스에 DP 기술을 적용해왔습니다.

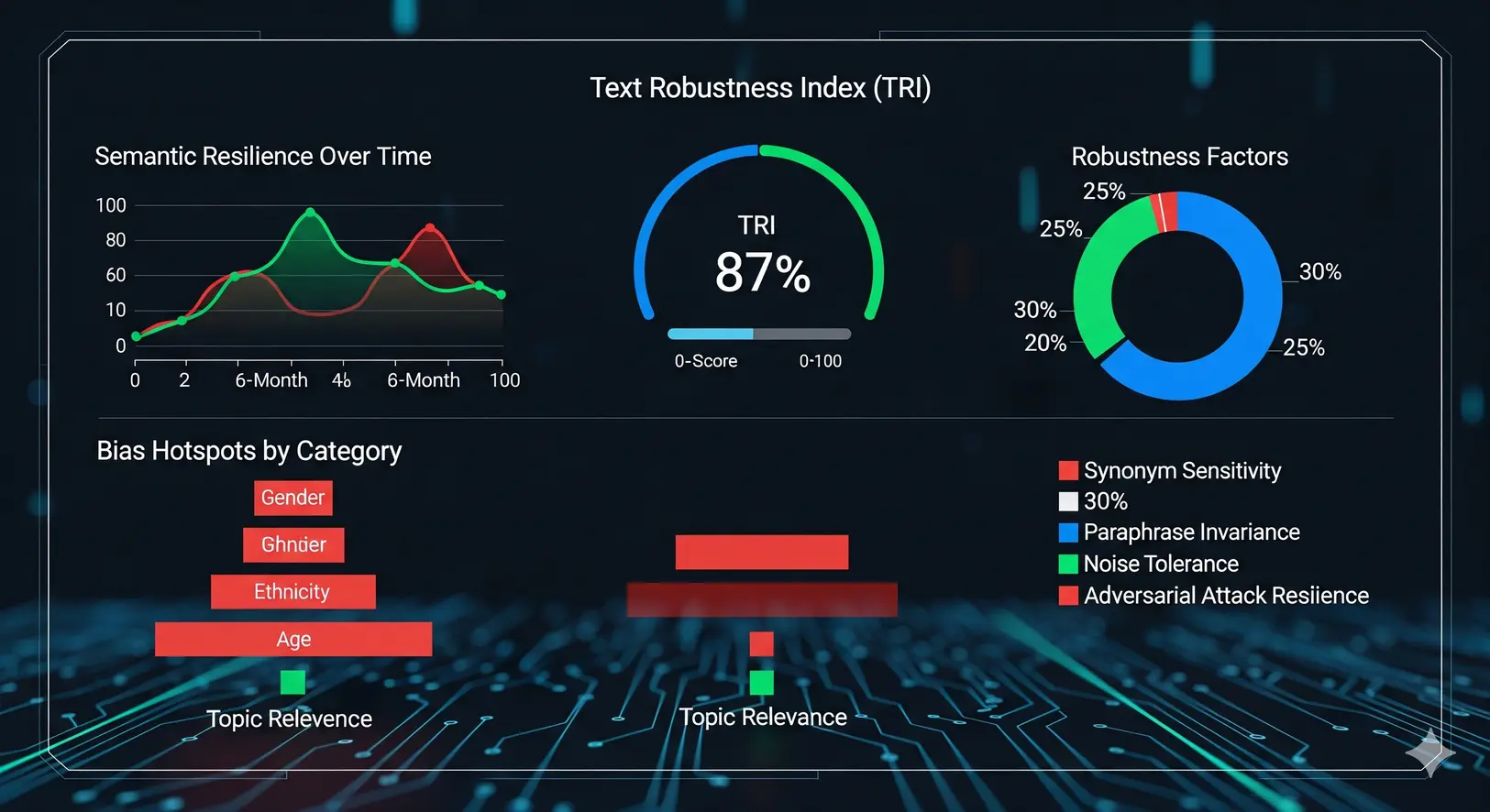

하지만 DP 기술에는 명백한 트레이드오프가 존재합니다. 개인정보보호 수준을 높이기 위해 소음을 많이 추가하면 데이터의 유용성, 즉 분석 결과의 정확도가 떨어집니다. 반대로 분석의 정확도를 높이기 위해 소음을 줄이면 개인정보보호 수준이 약화될 수 있습니다. 특히 데이터가 불균일할 때 이 문제는 더욱 심각해집니다. 예를 들어, 국가별 사용자 데이터를 분석할 때, 소수의 사용자만 존재하는 국가의 개인정보를 보호하기 위해 전체 데이터에 과도한 소음을 추가하면, 다수의 사용자를 보유한 국가의 데이터 분석 결과까지 왜곡되는 문제가 발생합니다.

DPPS의 혁신: ‘선택과 집중’을 통한 정확도 향상

구글이 새롭게 제안하는 DPPS는 이러한 문제를 해결하기 위해 ‘선택과 집중’ 전략을 사용합니다. 전체 데이터를 무작위로 분석하는 대신, 분석에 충분한 규모를 가진 데이터 ‘파티션(partition, 데이터의 부분 집합)’을 먼저 ‘차등 개인정보보호 방식’으로 선택합니다. 이후 선택된 대규모 파티션에 한해서만 DP 분석을 수행하는 것입니다.

DPPS의 핵심은 두 단계로 이루어집니다:

- 1. 비공개 파티션 선택: 각 파티션(예: 국가, 주, 도시 등)에 포함된 사용자 수를 차등 개인정보보호 기술을 적용해 비공개적으로 계산합니다. 이 값이 미리 정해진 기준치(threshold)를 넘는 ‘충분히 큰’ 파티션만 분석 대상으로 선택합니다. 이 ‘선택 과정’ 자체도 DP 기술로 보호되므로, 특정 파티션이 선택되었는지 여부를 통해 개인정보가 유출될 위험이 없습니다.

- 2. 선택된 파티션 분석: 선택된 대규모 파티션에 대해서만 표준 DP 분석을 수행합니다. 분석할 필요가 없는 소규모 파티션을 제외함으로써, 전체적으로 투입되는 소음의 양을 줄여 분석 결과의 정확도를 획기적으로 높일 수 있습니다.

결과적으로 DPPS는 모든 개인에 대한 강력한 개인정보보호 원칙을 지키면서도, 의미 있는 규모의 데이터 그룹에 대해서는 훨씬 더 정확하고 유용한 통계적 인사이트를 얻을 수 있게 해줍니다.

DPPS의 기대 효과와 미래

DPPS 기술은 특히 대규모 사용자 데이터를 다루는 IT 기업에게 중요한 의미를 가집니다. A/B 테스트 결과 분석, 시간대별 사용자 트렌드 분석, 개인화 서비스 개선 등 다양한 분야에서 활용될 수 있습니다.

과거에는 프라이버시 보호를 위해 포기해야 했던 데이터의 세분화된 분석이 가능해지면서, 기업은 사용자의 프라이버시를 존중하면서도 더 나은 서비스를 개발할 수 있는 기반을 마련하게 되었습니다. DPPS는 데이터 경제 시대에 개인정보보호와 기술 혁신이 함께 갈 수 있음을 보여주는 중요한 이정표가 될 것입니다. 구글은 해당 연구 결과를 ‘WWW 2024’ 학회에 발표하며 기술 생태계 전반의 발전에 기여하겠다는 의지를 밝혔습니다.